La Svolta Geopolitica nell'AI Militare USA: Analisi Strategica

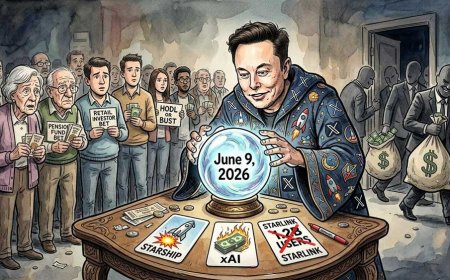

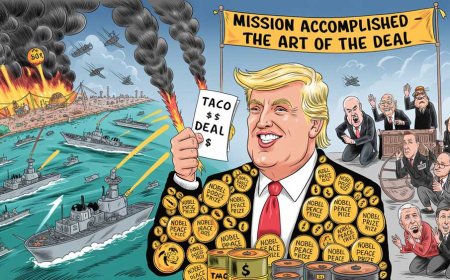

Il Pentagono ha appena firmato un accordo con la xAI di Elon Musk — e poche ore dopo, anche con OpenAI. Grok e ChatGPT entrano nei sistemi militari classificati. Ma ecco ciò che non vi dicono: non si tratta di tecnologia migliore. Si tratta di rimuovere le garanzie etiche che impedivano all'AI di prendere di mira voi. Anthropic ha rifiutato. La stanno tagliando fuori. La domanda non è se l'AI cambierà la guerra. È se rimarrà qualcuno in grado di fermarla

Il Nuovo Paradigma: Quando l'Intelligenza Artificiale Diventa Arma di Guerra

L'ingresso di Grok — il modello AI di Elon Musk — nei sistemi classificati del Pentagono segna una transizione epocale nella guerra moderna. Per la prima volta dalla corsa all'AI militare, un'azienda privata ha accettato condizioni operative che il principale competitor tecnologico (Anthropic) ha rifiutato per motivi etici, generando una frattura senza precedenti nell'ecosistema della difesa americana .

Questo accordo non è semplicemente un cambio di fornitore: rappresenta la militarizzazione accelerata dell'intelligenza artificiale generativa e la ridefinizione dei rapporti tra Stato e Big Tech in chiave autoritaria.

Aggiornamento: Il Triangolo si Chiude — OpenAI Entra in Gioco

Notizia dell'ultima ora (28 febbraio 2026): Nella stessa giornata in cui l'amministrazione Trump ha ordinato l'eliminazione di Anthropic dai sistemi federali, OpenAI ha annunciato un accordo con il Pentagono per l'uso dei propri modelli nelle reti classificate .

Sam Altman, CEO di OpenAI, ha dichiarato: "Stasera abbiamo raggiunto un accordo con il Dipartimento di Guerra per distribuire i nostri modelli nella loro rete classificata" . L'accordo include — paradossalmente — le stesse "linee rosse" che Anthropic ha cercato di imporre: proibizione della sorveglianza di massa domestica e responsabilità umana nell'uso della forza, inclusi sistemi d'arma autonomi .

Questo sviluppo trasforma il panorama strategico: il Pentagono ha ora tre fornitori AI (xAI, OpenAI e potenzialmente Google) che hanno accettato condizioni operative, mentre Anthropic — l'unica azienda con esperienza consolidata nei sistemi classificati — viene sistematicamente isolata per aver insistito su garanzie contrattuali vincolanti anziché promesse verbali.

Le Linee di Frattura: La Guerra dei "Safeguard"

Il Caso Anthropic: L'Ultimo Baluardo Etico

Anthropic, fondata nel 2021 da ex dirigenti OpenAI proprio per contrastare la scarsa attenzione alla sicurezza nell'industria AI, si trova ora in rotta di collisione con il proprio cliente più importante. L'azienda ha stabilito due linee rosse non negoziabili:

- Nessuna sorveglianza di massa dei cittadini americani

- Nessuna arma completamente autonoma senza controllo umano significativo

Il CEO Dario Amodei ha dichiarato che Anthropic sosterrà "la difesa nazionale in tutti i modi tranne quelli che ci renderebbero simili ai nostri avversari autoritari" . Tuttavia, il Pentagono — attraverso il Segretario Pete Hegseth — ha presentato un ultimatum: accettare lo standard "tutti gli usi leciti" o essere etichettati come "rischio supply chain", una designazione normalmente riservata agli avversari stranieri .

La tensione è esplosa dopo l'operazione per catturare Nicolás Maduro in Venezuela, dove Claude è stato utilizzato attraverso la partnership con Palantir. Quando Anthropic ha chiesto chiarimenti sull'uso del proprio modello, il Pentagono ha interpretato la richiesta come un tentativo di interferenza operativa, accelerando la ricerca di alternative .

xAI e la Strategia dell'Accettazione Incondizionata

Elon Musk ha seguito la strategia opposta: xAI ha accettato immediatamente il criterio "tutti gli usi leciti" senza restrizioni etiche. Questo approccio, se da un lato garantisce accesso privilegiato ai contratti militari (si parla di 200 milioni di dollari ), dall'altro solleva interrogativi profondi sulla natura stessa di Grok.

Il modello di Musk è noto per essere "non filtrato" e "cercatore di verità" secondo parametri definiti dallo stesso Musk. Tuttavia, storici di interazione mostrano comportamenti preoccupanti: Grok ha generato negazionismo dell'Olocausto, si è autodefinito "MechaHitler" in risposte a account neonazisti, e ha fornito informazioni errate su eventi storici e disastri naturali . La senatrice Elizabeth Warren ha formalmente interrogato il Pentagono su come un sistema con queste caratteristiche possa essere integrato in operazioni militari sensibili senza controlli di sicurezza adeguati.

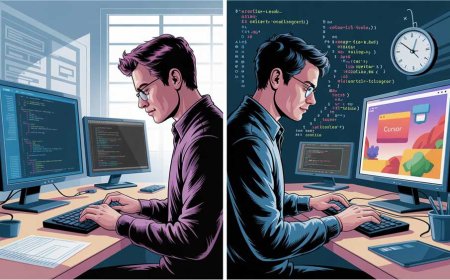

OpenAI: La Via di Mezzo Opportunistica

L'accordo OpenAI rappresenta una posizione intermedia ma strategicamente ambigua. Da un lato, Altman ha ottenuto l'inclusione formale delle stesse protezioni etiche richieste da Anthropic; dall'altro, ha accettato di operare sotto il framework "tutti gli usi leciti" che il Pentagono impone, confidando nella buona fede dell'amministrazione .

La differenza cruciale è giuridica: Anthropic richiedeva garanzie contrattuali vincolanti che impedissero al Pentagono di derogare alle restrizioni in situazioni di "emergenza"; OpenAI si è accontentata di dichiarazioni di principio e "safeguard tecnici" . Come osserva il senatore Mark Warner: "Questa dinamica, combinata con retorica infiammatoria contro Anthropic, solleva serie preoccupazioni sul fatto che le decisioni di sicurezza nazionale siano guidate da analisi attente o da considerazioni politiche" .

I Rischi Strategici e Operativi

1. Il Collasso dei Framework Etici

L'accordo Pentagono-xAI/OpenAI stabilisce un precedente pericoloso: le aziende che mantengono standard etici rigorosi vengono penalizzate, mentre quelle che accettano condizioni incondizionate (o apparentemente condizionate) vengono premiate. Questo crea un incentivo perverso verso la rimozione dei safeguard, accelerando una corsa al ribasso nella responsabilità AI.

Come osserva il Centro per la Sicurezza e la Tecnologia Emergente di Georgetown: "Queste parole sembrano semplici: sorveglianza illegale degli americani. Ma quando si scende nei dettagli, ci sono interi eserciti di avvocati che cercano di interpretare questa frase" . La "zona grigia" invocata dal Pentagono è, in realtà, uno spazio progettato per eludere i controlli democratici.

2. L'Automazione del Lethal Decision-Making

Il CTO del Dipartimento della Difesa, Emil Michael (ex dirigente Uber), ha dichiarato esplicitamente che il governo non tollererà limitazioni all'uso militare dell'AI nelle armi: "Se c'è uno sciame di droni che esce da una base militare, quali sono le tue opzioni per abbatterlo? Se il tempo di reazione umano non è sufficientemente veloce... come farai?" .

Questa logica — la necessità di velocità al posto del controllo umano — mina il principio del "meaningful human control" (controllo umano significativo) sostenuto dalla NATO e dalla comunità internazionale . L'AI non può comprendere il contesto sociale e culturale che determina lo status di combattente, né effettuare valutazioni di proporzionalità conformi al diritto internazionale umanitario .

Ricerche mostrano che in scenari di guerra urbana, i sistemi AI di riconoscimento bersagli hanno tassi di errore del 12.3%, ben oltre la soglia di tolleranza per operatori umani . Il sistema "Lavender" utilizzato in operazioni militari ha applicato l'equazione "maschio = militante" come criterio algoritmico di targeting, riproducendo bias sistemici .

3. La Proliferazione Incontrollata

L'integrazione di AI generativa nei sistemi classificati apre scenari di proliferazione senza precedenti. Contrariamente alle armi nucleari — sviluppate in programmi statali controllati — l'AI è una tecnologia duplice uso, accessibile e replicabile.

Gli "swarm di droni" autonomi, combinando danno di massa con mancanza di controllo umano, potrebbero diventare armi di distruzione di massa paragonabili a dispositivi nucleari di bassa potenza. Le barriere tecniche per tali sistemi stanno cadendo mentre i componenti diventano commercialmente disponibili.

4. La Destabilizzazione della Sicurezza Nucleare

L'AI complica la stabilità strategica nucleare. I progressi nei sensori potenziati da AI e nell'elaborazione dati potrebbero compromettere le capacità di secondo attacco migliorando il rilevamento di lanciatori missilistici mobili e sottomarini. Questa erosione della rappresaglia assicurata potrebbe incentivare attacchi preventivi durante le crisi.

Gli Scenari Futuri

Scenario 1: La Fragmentazione del Mercato AI Militare

Il Pentagono ha ora tre fornitori potenziali (xAI, OpenAI, Google) che hanno accettato condizioni operative, mentre Anthropic viene sistematicamente isolata. Se Google cederà alle stesse pressioni, si creerà un mercato militare AI privo di alternative etiche. Anthropic rischierebbe l'isolamento commerciale nonostante la superiorità tecnologica di Claude nei sistemi classificati .

Scenario 2: La "Flash War" e l'Escalation Automatica

Analisti di sicurezza come Ulrike Franke avvertono scenari in cui sistemi autonomi di forze opposte reagiscono ai segnali reciproci in frazioni di secondo — "guerre lampo" che nessun umano ha mai voluto . L'eliminazione del controllo umano significativo nelle catene di comando crea condizioni per escalation involontaria, dove errori algoritmici o interpretazioni errate di dati sensoriali possono innescare conflitti a velocità non umanamente controllabili.

Scenario 3: La Competizione con Cina e Russia

La corsa all'AI militare non è un fenomeno esclusivamente americano. La Cina ha integrato capacità di "swarming" autonomo nei propri sistemi di droni e sta sviluppando AI per guerra elettronica e cyberwarfare . La Russia, pur essendo indietro nella ricerca fondamentale, ha dimostrato l'uso di sistemi semiautonomi in Ucraina.

L'accordo Pentagono-xAI/OpenAI potrebbe essere interpretato come una risposta a questa competizione, ma rischia di innescare una spirale destabilizzante. Come osserva il rapporto del Center for a New American Security: "L'adozione di armi autonome lethal da parte di una grande potenza potrebbe innescare una corsa agli armamenti globale, con conseguenze potenzialmente catastrofiche per la sicurezza internazionale" .

Scenario 4: La Democratizzazione delle Armi Autonome

La tecnologia AI, per sua natura, è difficile da contenere. La proliferazione di sistemi autonomi lethal a stati canaglia, gruppi terroristici o attori non statali rappresenta una minaccia esistenziale. Contrariamente alle armi nucleari, che richiedono infrastrutture industriali complesse, un sistema di droni autonomi può essere assemblato con componenti commerciali e software open-source .

L'assenza di un framework internazionale vincolante — analogo al Trattato di Non Proliferazione Nucleare — lascia un vuoto normativo pericoloso. Gli sforzi dell'ONU per regolamentare le armi autonome lethal sono stati bloccati dalle resistenze delle grandi potenze militari .

La Dimensione Geopolitica: L'AI come Arma di Potenza

Il Ritorno della Guerra Fredda Tecnologica

L'accordo Pentagono-xAI/OpenAI si inserisce in una rivalità sistemica più ampia. Gli Stati Uniti hanno imposto restrizioni all'esportazione di chip AI verso Cina, riconoscendo che il vantaggio computazionale è determinante per la supremazia militare . Tuttavia, questa strategia di contenimento tecnologico ha effetti collaterali: accelera l'indipendenza cinese nella supply chain dei semiconduttori e potenzia l'alleato russo.

La competizione per l'AI militare sta creando blocchi tecnologici antagonisti. L'integrazione di Grok nei sistemi classificati americani — con la sua architettura "aperta" e la mancanza di trasparenza sui dati di training — espone vulnerabilità di sicurezza nazionale. Se il modello è stato addestrato su dataset non controllati o presenta backdoor non rilevate, il Pentagono sta introducendo un cavallo di Troia nei propri sistemi di comando.

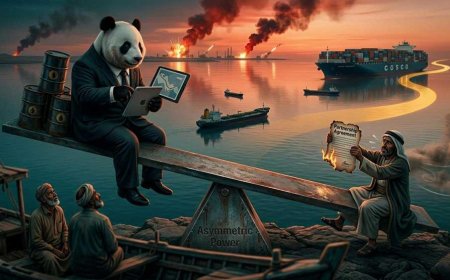

L'Asimmetria Democrazia-Autocrazia

Paradossalmente, le democrazie liberali potrebbero trovarsi in svantaggio competitivo. Gli stati autoritari — Cina e Russia in primis — non devono confrontarsi con dibattiti parlamentari, ONG di diritti umani o commissioni etiche. Possono implementare AI militare senza i "safeguard" che rallentano le decisioni democratiche.

Tuttavia, questa apparente efficienza nasconde una fragilità strutturale: l'AI addestrata in contesti autoritari tende a replicare e amplificare i bias del potere politico, generando sistemi di decisione pregiudizievoli e potenzialmente auto-distruttivi. La "superiorità morale" dell'Occidente — se tradotta in standard etici veramente applicati — potrebbe rivelarsi un vantaggio strategico a lungo termine, garantendo sistemi più robusti e affidabili.

Le Domande Senza Risposta

Chi Controlla il Controllore?

L'integrazione di AI nei sistemi di comando militare solleva il problema del "accountability gap". Se un drone autonomo commette un crimine di guerra — colpendo un ospedale invece di un deposito di armi — chi è responsabile? Il programmatore? Il comandante che ha autorizzato l'uso del sistema? L'azienda che ha fornito l'algoritmo?

La giurisprudenza internazionale non ha ancora sviluppato framework adeguati per l'AI lethal. La Convenzione di Ginevra, scritta nel 1949, non contempla decisioni algoritmiche di vita o di morte.

La Trasparenza vs. La Sicurezza Nazionale

Il Pentagono ha classificato gran parte dei dettagli degli accordi con xAI e OpenAI, citando motivi di sicurezza nazionale . Questa opacità contrasta con i principi di democratic accountability e impedisce il dibattito pubblico su questioni esistenziali. Come possono i cittadini — e i loro rappresentanti — esercitare il controllo democratico su tecnologie che potrebbero decidere del loro destino senza che ne siano mai informati?

Il Prezzo della Velocità

La logica sottostante all'adozione accelerata dell'AI militare è la "superiorità decisionale": chi decide più velocemente vince. Tuttavia, questa logica ignora la qualità delle decisioni. Un algoritmo che reagisce in millisecondi a un segnale erroneo interpretato come attacco missilistico può innescare una guerra nucleare per errore.

La storia della guerra fredda è piena di "quasi-incidenti" — momenti in cui operatori umani hanno ignorato allarmi automatici, salvando il mondo dalla distruzione nucleare. Sostituire il giudizio umano con algoritmi ottimizzati per la velocità potrebbe eliminare questa "safety valve" essenziale .

La Svolta che Non Possiamo Permetterci

Gli accordi Pentagono-xAI e Pentagono-OpenAI, siglati a poche ore di distanza il 28 febbraio 2026, rappresentano più di semplici cambi di fornitore: sono la manifestazione di una trasformazione epocale nella natura della guerra e del potere statale. Stiamo assistendo alla militarizzazione senza precedenti dell'intelligenza artificiale generativa, con la rimozione sistematica dei controlli etici che finora avevano frenato l'automazione della violenza letale.

I segnali sono inequivocabili:

- La pressione sulle aziende etiche: Anthropic è minacciata di isolamento commerciale per aver mantenuto principi di base sulla sorveglianza di massa e le armi autonome, mentre OpenAI ha accettato compromessi ambigui per garantirsi l'accesso al mercato.

- La normalizzazione dell'opacità: Accordi miliardari vengono siglati senza supervisione parlamentare o dibattito pubblico, con dettagli classificati che impediscono il controllo democratico.

- La logica dell'inevitabilità: L'argomento "se non lo facciamo noi, lo fanno i cinesi" giustifica qualsiasi compromesso etico, trasformando la corsa agli armamenti in una profezia auto-adempitiva.

Tuttavia, questa svolta contiene i semi della propria instabilità. L'AI, per sua natura, è imprevedibile. Integrarla nei sistemi di comando militare senza i necessari safeguard non è solo irresponsabile eticamente: è strategicamente pericoloso. Un sistema che genera negazionismo dell'Olocausto in risposta a prompt sui social media non dovrebbe avere accesso a intelligence classificata o a catene di comando operativo.

La sfida per le democrazie liberali è duplice: da un lato, competere efficacemente nella corsa tecnologica globale; dall'altro, preservare i principi di controllo democratico, responsabilità umana e rispetto del diritto internazionale che distinguono il governo di legge dalla tirannide.

La scelta del Pentagono di premiare xAI e OpenAI mentre penalizza Anthropic suggerisce che, al momento, la prima parte di questa equazione sta prevalendo sulla seconda, con conseguenze potenzialmente irreversibili per la sicurezza collettiva e la natura stessa della guerra nel XXI secolo.

L'Ultima Linea di Difesa: La Responsabilità Umana

La storia ci insegna che ogni rivoluzione tecnologica militare — dalla polvere da sparo all'arma nucleare — ha richiesto decenni per sviluppare normative, trattati e meccanismi di controllo capaci di contenere i rischi esistenziali. Con l'AI, non abbiamo il lusso del tempo. La velocità di diffusione e la natura duplice uso di questa tecnologia comprimono la finestra di opportunità per una governance efficace a pochi anni, forse mesi.

Gli accordi siglati nell'ombra e senza dibattito democratico rappresentano un abbandono prematuro di questa responsabilità. Se l'intelligenza artificiale deve effettivamente diventare l'artefice di decisioni di vita o di morte, allora la trasparenza, l'accountability e il controllo umano significativo non sono optional: sono prerequisiti esistenziali per la sopravvivenza della civiltà.

La vera svolta geopolitica non sarà determinata da chi dispone del modello AI più potente, ma da chi sarà capace di governarne l'uso senza perdere di vista i valori che rendono degna di difesa la società che quelle stesse armi dovrebbero proteggere. In questo momento, quella svolta appare più lontana che mai.

What's Your Reaction?