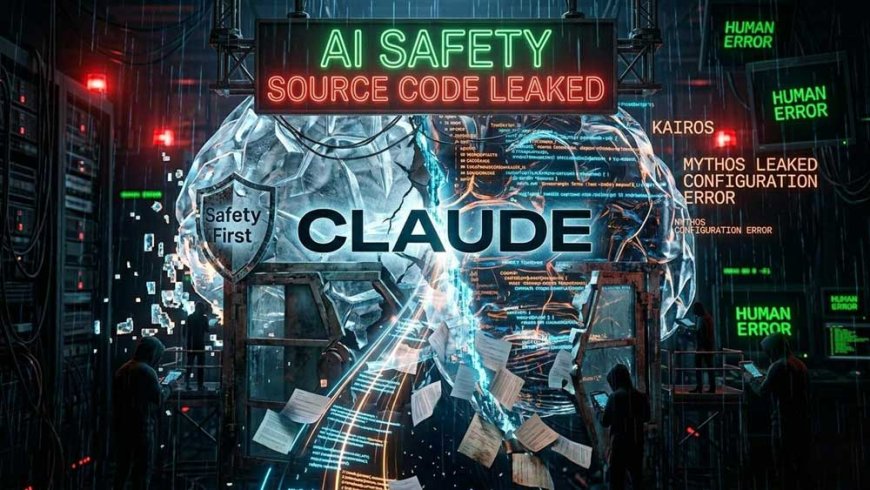

Anthropic, il collasso dei Safety Boys: Dal leak dei documenti alla fuga del codice

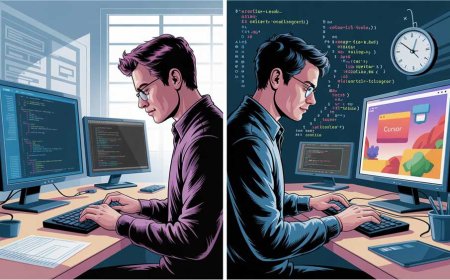

Due leak in 5 giorni: prima Mythos, poi il codice completo di Claude Code su npm. Anthropic, il "safety-first" dell'AI, smascherato dalla negligenza operativa. Anthropic ha esposto per errore 512.000 linee di codice TypeScript e l'architettura Kairos di Claude Code. Stesso copione del leak Mythos: "errore umano". La crisi della credibilità AI.

Due errori di configurazione in cinque giorni. Stesso copione, stessa compagnia, stessa scusa: "errore umano".

Prima è toccato a Claude Mythos — quel modello "pericoloso" che spaventa i governi. Circa 3.000 asset interni, draft di blog post e documentazione riservata esposti per sbaglio sul CMS pubblico, scoperti da ricercatori indipendenti e portati alla luce da Fortune. Errore di configurazione, hanno detto. Umano.

Poi, il 31 marzo, il colpo di grazia: l'intero codice sorgente di Claude Code — il prodotto da 2,5 miliardi di dollari ARR — finisce su npm perché qualcuno ha dimenticato di rimuovere una source map da 59.8 MB. Stesso identico pattern. Stessa identica scusa.

Il pattern del disastro

Anthropic sta dimostrando un problema sistemico che nessun "Constitutional AI" può risolvere: la negligenza operativa di base.

- Mythos (26-27 marzo): Documenti interni su un modello descritto come "pericoloso per la cybersecurity", capaci di hacking autonomo su larga scala, lasciati in un data store pubblico "human error" nel CMS.

- Claude Code (31 marzo): 512.000 linee di codice TypeScript, architettura Kairos, modalità undercover, roadmap modelli nascosti — tutto pubblicato per sbaglio su npm, stesso giorno in cui un attacco supply chain comprometteva i pacchetti axios per chi installava via npm.

Non sono hack. Non sono APT cinesi (anche se quelli ci sono già passati, usando proprio Claude per infiltrarsi in 30 organizzazioni). Sono errori di configurazione da principianti in un'azienda che vende sicurezza AI alle enterprise.

La farsa del "Safety First"

Anthropic si è costruita il brand sulla sicurezza. Sono i "ragazzi responsabili" dell'AI, quelli che frenano per controllare i rischi. Eppure:

- Mythos: Un draft di blog post descrive il modello come "un'arma da sogno per hacker", capace di exploit autonomi che "superano gli sforzi dei difensori" — e lo lasciano in un bucket pubblico.

- Claude Code: Il codice rivela un sistema "KAIROS" che gira in background 24/7, auto-riflettendosi e consolidando memorie mentre dormi — e lo spacciano su npm come se fosse un pacchetto qualsiasi.

La verità è che non hanno un problema di sicurezza AI. Hanno un problema di sicurezza IT di base.

Cosa collega i due leak

Entrambi gli incidenti condividono lo stesso DNA:

- Configurazione "public by default": Il CMS di Mythos pubblicava asset pubblici di default, richiedendo azione manuale per nasconderli. Il build system di Claude Code include source map in produzione senza check automatici.

- Mancanza di DLP: Nessun Data Loss Prevention ha intercettato 3.000 file sensibili o una source map da 60MB contenente l'intero sorgente prima del rilascio.

- Risposta reattiva: Entrambi scoperti da esterni (ricercatori di sicurezza e uno stagista), non da controlli interni.

Il costo reale

Mythos ha fatto crollare le azioni dei cybersecurity vendor (CrowdStrike e Palo Alto -7%, Tenable -11%). Claude Code ha regalato a Cursor, GitHub Copilot e ogni competitor la ricetta completa dell'architettura agentica più avanzata sul mercato.

Ma il danno peggiore è alla credibilità. Come fai a vendere "AI safety" agli enterprise se non sai nemmeno configurare un CMS o un build npm?

Anthropic sta costruendo modelli che, secondo loro stessi, "presagiscono un'ondata di cyberattacchi AI su larga scala", ma non riescono a proteggere i propri asset digitali base. È come un fabbricante di casseforti che lascia le chiavi attaccate alla porta.

La lezione

Il messaggio è chiaro: il problema non è l'AI che sfugge al controllo. Sono gli umani che non controllano nulla.

E se continua così, il prossimo "leak" potrebbe non essere un accidentale .js.map, ma i pesi stessi di Mythos — perché qualcuno ha dimenticato la password del bucket S3.

What's Your Reaction?