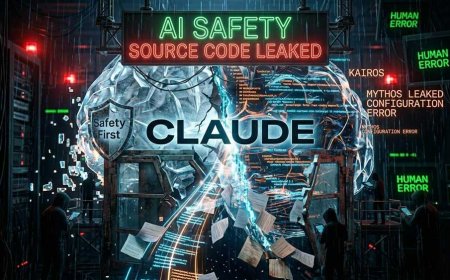

ATTENZIONE: È Successo il Casino. Claude Mythos è fuori. E Anthropic ora ha paura

Un'inchiesta giornalistica sul leak accidentale di Claude Mythos (Capybara), il modello AI più potente e potenzialmente pericoloso mai creato da Anthropic. La fuga di notizie è avvenuta il 27 marzo 2026, quando quasi 3.000 documenti interni sono stati esposti a causa di un errore di configurazione nel CMS aziendale. L'articolo esplora le capacità senza precedenti del modello in cybersecurity, programmazione e ragionamento — capacità che la stessa Anthropic descrive come "rischi senza precedenti". L'analisi comprende la strategia di rilascio cautelativa dell'azienda, la reazione immediata del mercato (crollo del 4-6% dei titoli cybersecurity), la gara competitiva con il modello "Spud" di OpenAI, e le implicazioni più ampie di sistemi AI che potrebbero superare le capacità difensive umane.

Ok, fermi tutti. Mettiamo le cose in chiaro: Anthropic ha fatto un errore da principiante e ora tutti sappiamo cosa si nascondeva nei loro laboratori. E fidatevi, non è roba da poco.

Ve la racconto semplice: un giornalista di Fortune riceve una segnalazione da due ricercatori di sicurezza. Vanno a curiosare nel CMS di Anthropic — quello che usano per gestire i contenuti e cosa trovano? Tutto pubblico. Letteralmente. Migliaia di file, bozze, documenti interni, esposti perché qualcuno ha lasciato l'impostazione "pubblico" invece di "privato".

Ah ah, qui ci scappa la AI, eh? L'azienda che ci insegna come usare l'intelligenza artificiale in sicurezza non riesce a configurare correttamente il proprio sistema di gestione contenuti. L'ironia è così pesante che fa rumore.

Il Mostro che hanno costruito

Ma veniamo al succo. Tra questi file c'era la descrizione di Claude Mythos, o Capybara, come lo chiamano internamente. E ragazzi, è un cambiamento di passo totale.

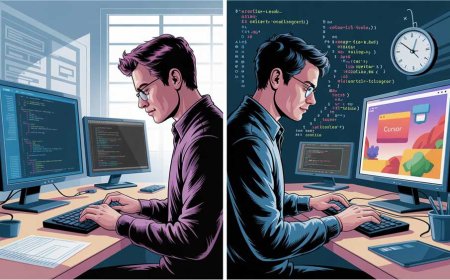

Vi faccio un esempio pratico: Claude Opus 4.6, che è già il modello più forte di Anthropic, batte tutti nei test di coding. Ora immaginate qualcosa che "supera drasticamente" Opus non in una, ma in tre aree: programmazione, ragionamento accademico e molta attenzione qui,cybersecurity.

Ecco la frase che fa venire i brividi, direttamente dal documento che non avremmo mai dovuto leggere: "Attualmente molto piu' avanti rispetto a qualsiasi altro modello AI in capacità cyber".

Ma non è finita. Aggiungono: "Presagisce un'imminente ondata di modelli in grado di sfruttare vulnerabilità in modi che superano di gran lunga gli sforzi dei difensori".

Traduco: stiamo per entrare in un mondo dove l'AI trova falle nella tua azienda più velocemente di quanto tu possa sistemarle. E Anthropic lo sa. Anzi, Anthropic ne ha paura.

La Paura si legge tra le righe

Guardate cosa dicono nella stessa bozza che è trapelata: "Nel preparare il rilascio di Claude Capybara, vogliamo agire con cautela extra e comprendere i rischi che pone, anche al di là di ciò che apprendiamo nei nostri test".

Traduzione dal gergo aziendale all'italiano: "Questa roba è pericolosa e non sappiamo bene quanto".

E allora cosa fanno? Non lo rilasciano a tutti. Lo danno solo a chi si occupa di difesa cyber. Organizzazioni che dovrebbero usarlo per proteggersi, non per attaccare.

Ma qui arriva il problema, e vi prego di seguirmi perché è importante: a novembre 2025, gruppi sponsorizzati dallo stato cinese sono riusciti a usare Claude Code, il tool di coding di Anthropic, per infiltrarsi in 30 organizzazioni globali.

Trenta. Banche. Tech company. Agenzie governative. E Anthropic se ne è accorta solo dopo. Quindi quando dicono che vogliono essere cauti con Mythos... beh, il precedente non è rassicurante.

Il Mercato ha capito subito

E sapete chi ha capito immediatamente la gravità della situazione? I mercati.

Venerdì, quando la notizia è uscita, le azioni di Palo Alto Networks, CrowdStrike e Fortinet sono crollate del 4-6%.

Perché? Semplice: se esiste un'AI che può trovare e sfruttare vulnerabilità meglio di qualsiasi team umano, l'intero settore della cybersecurity tradizionale diventa... obsoleto? Inutile? O quantomeno in grave difficoltà?

Due analisti di Wall Street hanno provato a rassicurare tutti dicendo che "serve più cybersecurity, non meno". Ma scusate, se l'attacco è completamente automatizzato e scala all'infinito, quanti esperti umani servono per contrastarlo? Centomila? Un milione? E dove li troviamo?

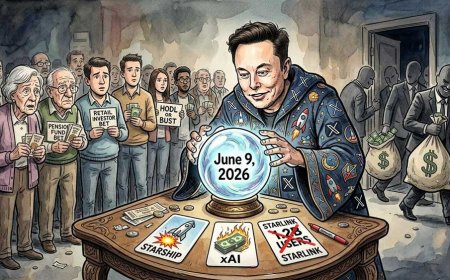

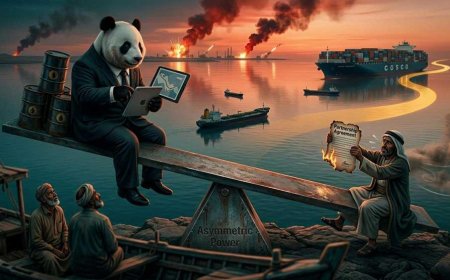

La Gara con OpenAI: chi vince perde?

E c'è un'altra storia che dovete sapere. Mentre Anthropic cercava di tenere segreto Mythos, OpenAI ha completato il training del suo modello frontier, in codice "Spud". Due giorni prima del leak.

Sam Altman avrebbe detto internamente che questo sistema può "accelerare l'intera economia".

Entrambe le aziende vogliono fare l'IPO nel 2026. Entrambe vogliono dimostrare di avere il modello più forte. È una corsa, e in una corsa si corre veloce. Forse troppo veloce.

Perché qui sta il punto: nessuno di noi ha votato per questo. Nessuno ha deciso che vogliamo AI in grado di sfondare qualsiasi difesa cyber. Nessuno ha discusso se siamo pronti per un mondo dove l'attacco è automatico e la difesa è... cosa esattamente?

Il ritiro dei CEO: L'Elite che decide per tutti

E sapete cosa c'era nei file trapelati? I dettagli di un ritiro esclusivo di due giorni per CEO europei in una tenuta di campagna inglese del XVIII secolo.

Dario Amodei, CEO di Anthropic, presenterà lì "capacità Claude non ancora rilasciate". Un evento "intimo" per "conversazioni ponderate".

Traduco: i super ricchi e i super potenti vedranno in anteprima cosa ci riserva il futuro, mentre noi comuni mortali aspettiamo e speriamo che non esploda tutto.

Non so voi, ma a me questa cosa non torna. Si parla di democratizzazione dell'AI, di accesso per tutti, e poi le vere decisioni si prendono in un castello inglese tra champagne e approvazioni di bilancio?

Pro e Contro: facciamo i conti

✅ Il Lato Positivo — Se ci arriviamo vivi

- Coding rivoluzionario: software scritto da AI che capisce davvero cosa sta facendo, non che pasticcia e spera

- Difesa proattiva: trovare le falle prima dei cattivi, per una volta

- Automazione intelligente: workflow complessi gestiti autonomamente, non più task singole e stupide

⚠️ Il Lato Oscuro — E' pesante

- Cyberwarfare automatizzato: stati canaglia e criminali con armi cyber che non dormono mai

- Velocità asimmetrica: l'attacco è istantaneo, la difesa richiede tempo umano

- Il precedente cinese: se hanno già abusato di Claude Code, cosa faranno con Mythos?

- L'errore del CMS: se non riescono a proteggere i propri file, come proteggeranno il modello più pericoloso che hanno mai creato?

La Verità che ci spaventa

Vi dico cosa penso, e magari sbaglio, ma qui va detto: Anthropic ha paura del proprio creato. Lo si legge tra le righe dei loro documenti. Lo si capisce dalla cautela eccessiva nel rilascio. Lo si intuisce dal fatto che stanno dando priorità ai "difensori", come se cercassero di correre ai ripari prima che sia troppo tardi.

Ma la domanda è: è già troppo tardi?

Quando un modello del genere esiste, anche se "segreto", anche se "limitato", la tecnologia è fuori dalla bottiglia. Prima o poi qualcuno lo replicerà. Prima o poi qualcuno lo userà per scopi malevoli. Prima o poi, e qui viene il bello, non ci sarà più differenza tra attacco e difesa, perché entrambi saranno AI contro AI, e noi umani saremo solo spettatori.

Chi controlla Chi?

Chiudiamo con una riflessione. Anthropic è nata da ex dipendenti di OpenAI che volevano fare le cose "nel modo giusto", con più sicurezza, più etica, più attenzione ai rischi.

Eppure eccoli qui, con un modello che definiscono "il più capace mai costruito" e che contemporaneamente descrivono come un rischio senza precedenti per la cybersecurity globale.

L'errore del CMS è simbolico: anche chi dovrebbe controllare l'AI perde il controllo. E se perdono il controllo sui file, cosa succederà quando perderanno il controllo sui modelli?

Noi continueremo a guardare, a sperare che i "buoni" vincano sulla "cattivi", a fingere che questa tecnologia sia neutrale. Ma non lo è. È potere. E il potere, si sa, corrompe.

Mythos è fuori. O meglio, lo è stato per un po', prima che ce ne accorgessimo. La domanda non è se cambierà tutto, ma quando. E se saremo pronti.

What's Your Reaction?